Page 14 - HS 3 Taaltecnologie

P. 14

A.I. voor wiskunde

3.8.2 Attention is all you need

Zonder transformer… geen ChatGPT of andere GenAI

Het kernidee van de transformer is het "attention"-mechanisme (aandachtmechanisme).

Dit concept komt voort uit een onderzoekpaper van Google dat werd geschreven door Google Brain

rond 2017-2018.

In plaats van alleen te zoeken naar woorden, keek dit model met veel rekenkracht naar de context van

wat mensen daadwerkelijk naar elkaar schreven. Het resultaat is een geavanceerd voorspelmodel dat

met een hoge mate van waarschijnlijkheid kan bepalen welke woorden mensen waarschijnlijk in welke

context achter elkaar zullen plaatsen.

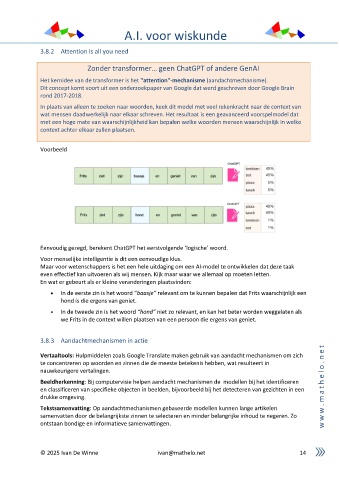

Voorbeeld

Eenvoudig gezegd, berekent ChatGPT het eerstvolgende ‘logische’ woord.

Voor menselijke intelligentie is dit een eenvoudige klus.

Maar voor wetenschappers is het een hele uitdaging om een AI-model te ontwikkelen dat deze taak

even effectief kan uitvoeren als wij mensen. Kijk maar waar we allemaal op moeten letten.

En wat er gebeurt als er kleine veranderingen plaatsvinden:

• In de eerste zin is het woord “baasje” relevant om te kunnen bepalen dat Frits waarschijnlijk een

hond is die ergens van geniet.

• In de tweede zin is het woord “hond” niet zo relevant, en kan het beter worden weggelaten als

we Frits in de context willen plaatsen van een persoon die ergens van geniet.

3.8.3 Aandachtmechanismen in actie

t

e

Vertaaltools: Hulpmiddelen zoals Google Translate maken gebruik van aandacht mechanismen om zich n

te concentreren op woorden en zinnen die de meeste betekenis hebben, wat resulteert in .

nauwkeurigere vertalingen. o l

e

Beeldherkenning: Bij computervisie helpen aandacht mechanismen de modellen bij het identificeren h

en classificeren van specifieke objecten in beelden, bijvoorbeeld bij het detecteren van gezichten in een t

a

drukke omgeving. m

.

Tekstsamenvatting: Op aandachtmechanismen gebaseerde modellen kunnen lange artikelen w

samenvatten door de belangrijkste zinnen te selecteren en minder belangrijke inhoud te negeren. Zo w

ontstaan bondige en informatieve samenvattingen. w

© 2025 Ivan De Winne ivan@mathelo.net 14